Hugging Face, c’est bien plus qu’un nom familier du monde de l’IA. C’est une véritable boîte à outils collaborative, pensée pour les chercheurs, développeurs et équipes techniques qui veulent aller vite — et bien. Modèles pré-entraînés, datasets géants, bibliothèques sur-mesure, éthique by design… tout y est pour expérimenter, partager et innover.

Vous vous demandez à quoi sert Hugging Face, comment choisir un modèle, ou quels outils utiliser pour entraîner votre prochain chatbot ? Ce guide vous donne les clés pour comprendre l’écosystème, exploiter ses ressources et éviter les pièges courants.

Accessible, puissant, documenté (en grande partie) et RGPD-friendly : si vous travaillez dans le NLP ou le machine learning, difficile d’y échapper. Et tant mieux. 🤖

Hugging Face : qu’est-ce que c’est et à quoi ça sert ?

Hugging Face, impossible de passer à côté : plateforme open source taillée pour l’IA, elle s’est imposée comme le repère favori des amateurs de NLP et de machine learning. Mais à quoi bon tout ça, concrètement ?

Un gigantesque hub collaboratif : des modèles pré-entraînés à disposition, des datasets partagés, des mises à jour en temps réel — le tout orchestré par une communauté engagée. C’est la caverne d’Ali Baba du développeur ou du chercheur qui veut éviter de réinventer la roue.

Mais Hugging Face, ce n’est pas juste de la tech. Leur mission ? Démocratiser une IA responsable , transparente, conforme au RGPD (oui, ils y veillent vraiment 😉).

Chercheurs, développeurs freelance ou équipes tech ambitieuses : tous y trouvent leur compte, dans un esprit d’ouverture éthique rarement égalé dans l’écosystème IA.

Les bibliothèques et outils phares proposés par Hugging Face

Plonger dans l’écosystème Hugging Face, c’est un peu comme ouvrir une boîte à outils taillée pour l’IA moderne. Des librairies pensées pour agir vite, aller loin et bricoler du concret. Laissez-moi vous présenter ces pépites, utilisées chaque jour pour des projets de NLP ou d’apprentissage profond.

Transformers : la star du lot. C’est ici qu’on retrouve les célèbres modèles pré-entraînés comme BERT ou GPT (et bien sûr, BLOOM avec ses titanesques 176 milliards de paramètres). Leur terrain de jeu ? La traduction automatique, le résumé de texte ou la génération de contenu. Résultat : gagner des heures de R&D sans repartir de zéro.

Besoin de manipuler vos jeux de données ? La bibliothèque Datasets le fait facilement, avec des intégrations natives PyTorch ou TensorFlow – fini les prises de tête côté format ou compatibilité ! Ajoutez Tokenizers pour découper le texte à la volée, Accelerate pour entraîner un modèle sur plusieurs GPUs, Spaces pour déployer vos démos interactives en ligne, et peft pour du fine-tuning ultra-rapide.

Petite synthèse ? Voici ce que chaque bibliothèque apporte concrètement :

- Transformers : modèles pré-entraînés pour NLP et génération de texte

- Datasets : chargement et transformation rapide des données

- Tokenizers : traitement avancé du texte

- Accelerate : distribution et accélération de l’entraînement

- Spaces : déploiement de prototypes IA accessibles à tous

- peft : optimisation personnalisée de modèles existants

Bref, vous voulez expérimenter sans (trop) galérer ? Hugging Face, c’est la planche à billets des outils IA. 🚀

Comment choisir et utiliser les modèles pré-entraînés sur le Hub ?

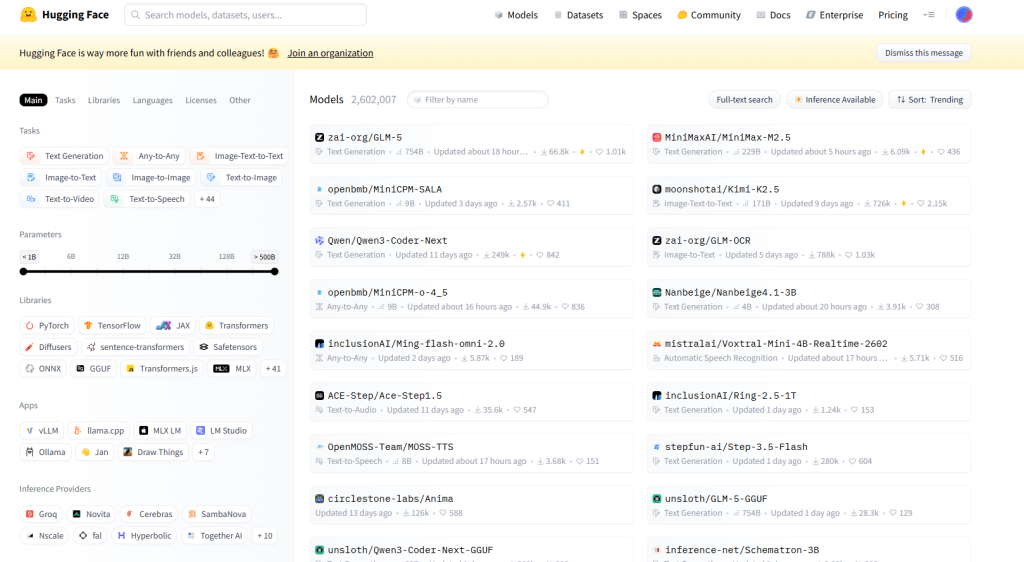

Plus de 1,8 million de modèles sur le Hub. Oui, le chiffre impressionne. Mais face à cette avalanche, comment s’y retrouver ? Première étape : trouver la perle rare. Filtrez par tâche, architecture, ou popularité. Un petit conseil entre nous : jetez toujours un œil à la model card du modèle. Ce document — parfois dense, parfois succinct — vous donne en un clin d’œil ses forces, limites, et biais éventuels.

Pour la suite, rien de plus simple. Un copié-collé du code d’exemple affiché sur la page du modèle, puis installation rapide des dépendances (souvent Transformers et autres librairies de machine learning associées). Quelques minutes plus tard : votre premier test local est prêt. Magie du Hub.

Sauf que… seulement 40 % des modèles sont documentés (chiffre 2023). Prudence, donc. Certains modèles peuvent réserver de mauvaises surprises, surtout sur des données sensibles ou peu courantes.

Vous préférez éviter les manipulations techniques ? Lancez un test via les Spaces. En un clic, une interface clé en main pour déployer une démo IA… sans aucune infrastructure locale à installer. Pratique pour tester, impressionner ou valider une idée 💡.

En résumé :

- Examinez la model card (capacités, limites, biais)

- Copiez le code proposé pour une installation éclair

- Pensez aux Spaces pour tester sans prise de tête

Restez vigilant sur l’interprétation des résultats : le Hub, c’est l’abondance. Mais aussi, parfois, des zones d’ombre.

Datasets : ressources, exemples et exploitation

Impossible de passer à côté : plus de 450 000 jeux de données open source sont accessibles sur la plateforme Hugging Face (recensement mi-2025). De quoi piocher, tester, réessayer — que vous soyez en quête de données pour vos modèles ou simplement curieux de ce qui se fait dans le machine learning.

Comment ne pas s’y perdre ? Un tip : utilisez la barre de recherche (avec quelques filtres bien choisis, on gagne un temps fou). Avant de foncer tête baissée, arrêtez-vous un instant. Moins de 30 % des jeux de données affichent une carte détaillée et documentée. Résultat : vérification manuelle obligatoire (personne n’a envie de tomber sur du contenu bancal, non ? 🕵️).

FineWeb ? Un exemple qui claque. 15 000 milliards de tokens en 2024 pour entraîner des LLM costauds. Les gros volumes, ça impressionne, mais l’intérêt est ailleurs : créer ou affiner vos modèles, grâce à des datasets calibrés selon vos besoins. Ne négligez pas cette étape : bien choisir votre dataset, c’est poser les fondations d’un projet solide, surtout en open source.

Quels avantages pour les entreprises et équipes tech ?

Accélérer l’innovation sans casser la tirelire. C’est possible avec Hugging Face. Grâce à la plateforme, la réduction des coûts de R&D n’est plus un rêve pour les équipes tech ambitieuses. La rapidité de prototypage séduit, surtout quand il s’agit de tester une idée folle à la pause-café et d’avoir un proof of concept avant la fin de la journée.

Accès à l’état de l’art. Communauté mondiale. Deux ingrédients clés du succès : c’est la promesse d’Hugging Face. Un champion qui, en 2023, a généré près de 70 millions de dollars de revenus annuels. La confiance règne, c’est évident.

Illustration concrète : le partenariat Google Cloud (2025). Résultat ? Un cache haute vitesse pour vos modèles… et une sécurité renforcée. Pour ceux qui doutent encore, Hugging Face garantit la confidentialité : logs limités à 30 jours, pas de stockage des données client (RGPD validé).

Formules flexibles :

- Plan individuel à partir de 9 $

- Plan équipe autour de 20 $

- Services managés pour les entreprises exigeantes

Intégrations premium : Azure, GKE, IBM Watson, NVIDIA… Que demander de plus ? Pour résumer, c’est la solution pour innover vite, sans sacrifier la sécurité ni la communauté. Tout le monde s’y retrouve – et avec le sourire 😎.

Pratiques responsables et limites à connaître

Hugging Face, c’est d’abord un pari sur l’éthique. La plateforme s’engage sur la transparence : tout miser sur l’open source, penser collectif (BigScience, BLOOM), avancer avec une gouvernance décentralisée. Voilà l’ambition affichée ! Mais, soyons honnêtes, tout n’est pas rose au pays de l’IA collaborative.

Pas de support officiel, une documentation parfois (trop) succincte… On s’y perd, surtout aux premiers pas. En entreprise, le passage en production pose aussi des questions sérieuses : sécurité, confidentialité, intégration, gestion de la montée en charge.

Difficile parfois de s’y retrouver : pas de benchmark standardisé – choisir le bon modèle, mission impossible ? Et attention aux biais cachés dans les algorithmes (personne n’est à l’abri…).

Envie d’exploiter tout le potentiel ?

- Testez localement avant de déployer

- Multipliez les validations manuelles

- Gardez un œil sur les dérives et les biais

Bref, prudence et rigueur sont de mise… même avec l’open source ! 🚦

Alternatives à Hugging Face : que comparer ?

Face à Hugging Face, le marché du machine learning regorge d’options. Que choisir ? TensorFlow Hub, Google AutoML, Azure ML, IBM Watson ou encore Amazon SageMaker. Tous proposent des modèles pré-entraînés, chacun avec sa recette et ses petits (ou gros) plus.

Mais comment trancher ? Petit tableau pour comparer, sans détour :

| Solution | Ouverture (open source ?) | Simplicité | Coût | Flexibilité |

|---|---|---|---|---|

| Hugging Face | Oui | Très accessible | Freemium | Haute |

| TensorFlow Hub | Oui | Technique | Gratuit | Moyenne |

| Google AutoML | Non | Simplifié | Payant | Moyenne |

| Azure ML | Non | Simplifié | Payant | Forte |

| IBM Watson | Non | Moyenne | Payant | Forte |

| Amazon SageMaker | Non | Technique | Payant | Très forte |

Ce qui change la donne ? La communauté engagée de Hugging Face, sa transparence – la promesse d’un écosystème open source, agile, mais surtout éthique. Perso, j’ai toujours trouvé plus simple d’échanger avec d’autres passionnés qu’avec un bot de support anonyme (et vous ? 🤔).

N’hésitez pas à explorer ces alternatives, selon votre niveau de maîtrise technique. Et pour élargir le comparatif, découvrez nos alternatives à ChatGPT.

La meilleure solution ? Rarement unique, souvent celle qui s’accorde vraiment à vos besoins.